Wenn KI das Fachwissen verdrängt: Die gefährliche Vereinfachung fragwürdiger Use Cases

Die Faszination für Künstliche Intelligenz ist zu einem Rauschen geworden, in dem verantwortungsvolle Innovation kaum noch von fahrlässiger Geschäftemacherei zu unterscheiden ist.

In den sozialen Medien und Foren wird eine Form intellektueller und ethischer Missachtung normalisiert: Unseriöse KI-Berater preisen „Use Cases“ an, die nicht nur irreführend, sondern auch brandgefährlich sind.

Sie versprechen eine Zukunft, in der komplexe Probleme auf Knopfdruck gelöst werden, und verschweigen dabei die alarmierenden Wahrheiten hinter dem Hype.

Präsentation: Die gefährliche Vereinfachung fragwürdiger Use Cases

KI versteht den Kontext nicht – sie erkennt nur Muster

Large Language Models (LLMs) wie ChatGPT, Mistral, Gemini und Claude „denken“ nicht. Sie verstehen weder Kausalität noch Bedeutung.

Ihre scheinbar intelligenten Antworten sind das Ergebnis einer hochentwickelten Mustererkennung, die auf unvorstellbar grosse Datenmengen angewandt wird.

Diese grundlegende technische Grenze wird in den derzeit kursierenden populären Anwendungsfällen bewusst ignoriert. Zwei Beispiele entlarven die Täuschung:

- Das Blutbild: Eine KI kann zwar die Werte auf einem Laborbericht auslesen, doch sie ist blind für das, was fehlt. Sie erkennt zwar fehlende, aber entscheidende Marker, kann die Daten jedoch nicht in den medizinischen Gesamtkontext eines Menschen einordnen.

- Das Kühlschrankfoto: Eine KI identifiziert Lebensmittel auf einem Foto, doch sie hat keine Ahnung von Haltbarkeitsdaten, Nährwerten oder der individuellen Verträglichkeit. Ein auf dieser Basis erstellter Ernährungsplan ist im besten Fall nutzlos, im schlimmsten Fall gesundheitsschädlich.

Wenn in diesen Beispielen nicht erwähnt wird, dass der User fehlende Angaben ergänzen sollte, ist das unseriös. Ebenso, wenn nicht darauf hingewiesen wird, dass es für manche Situationen doch einen Arzt oder einen Berater benötigt.

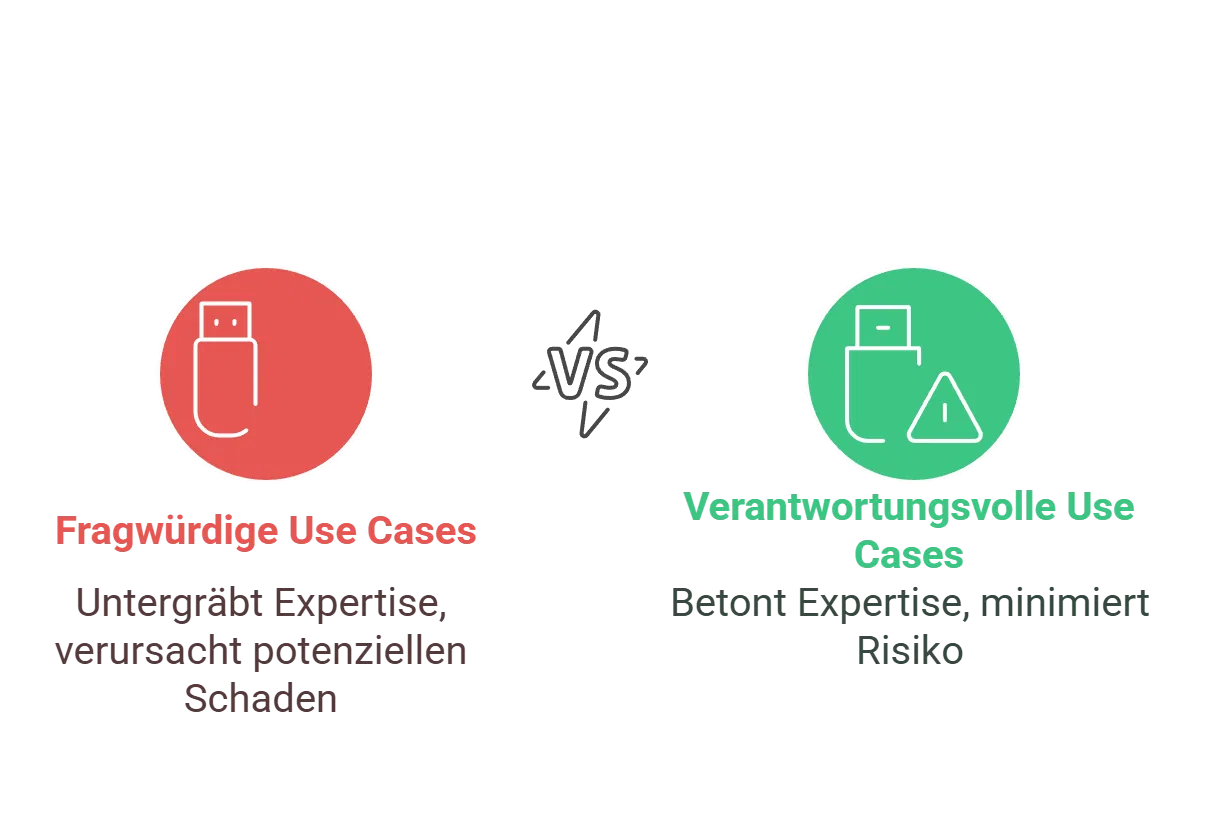

Indem sie solche Anwendungsfälle bewerben, wiegen unseriöse KI-Berater ihre Kunden in falscher Sicherheit, die die Technologie nicht leisten kann. Genau diese gefährliche Illusion des Verstehens wird von unverantwortlichen Akteuren ausgenutzt und führt zu einer systematischen Entwertung echter Expertise.

Der KI-Hype untergräbt den Wert echter Fachexpertise

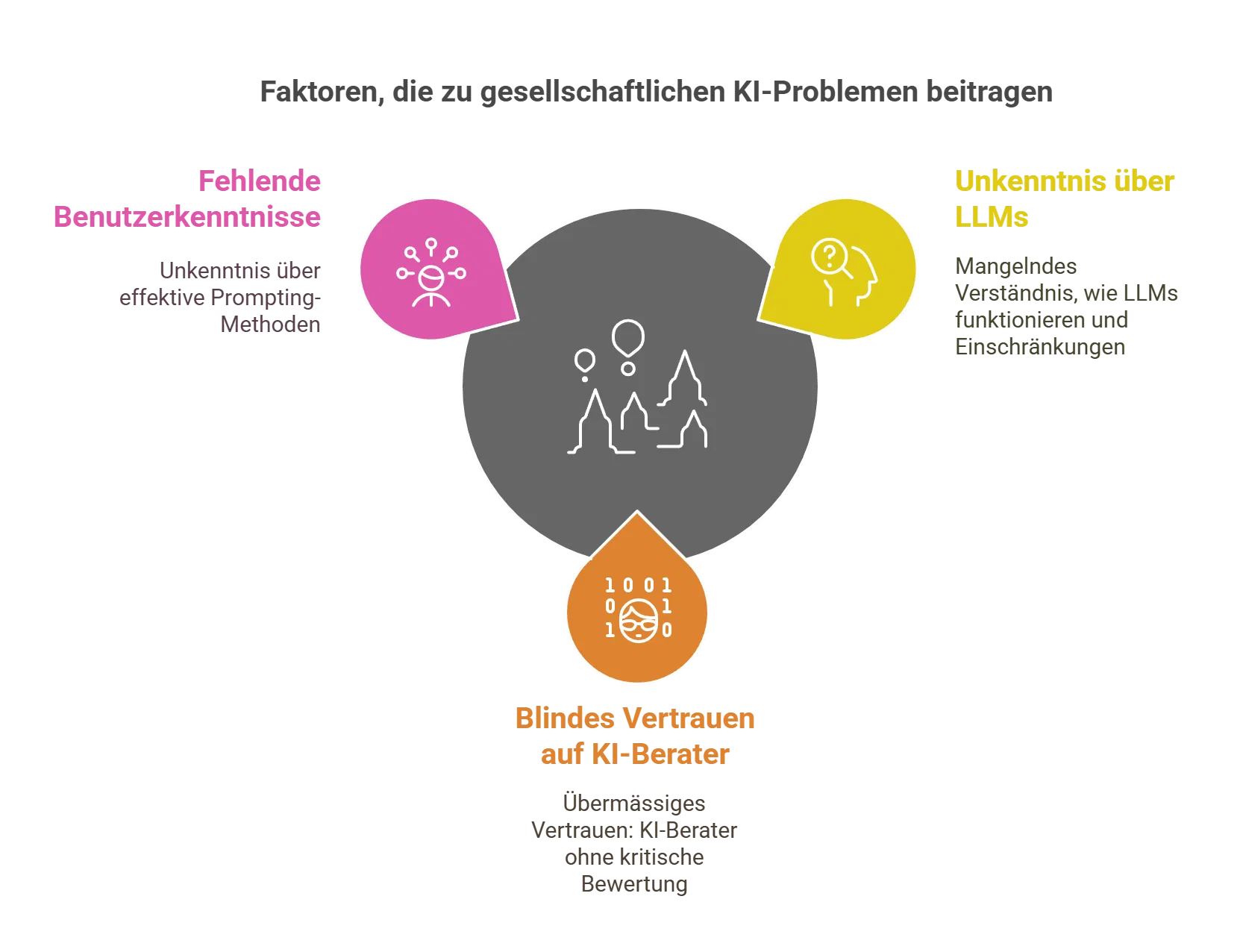

Die Folgen dieses unverantwortlichen Hypes gehen weit über technische Missverständnisse hinaus und verursachen greifbaren gesellschaftlichen Schaden.

Wenn leere Versprechen die Oberhand gewinnen, wird fundiertes Fachwissen systematisch abgewertet.

Anbieter nutzen das Unwissen der Öffentlichkeit aus, um qualifizierte Fachkräfte durch scheinbar einfache, aber unzuverlässige KI-Lösungen zu verdrängen. Nutzer, die auf solche Empfehlungen vertrauen, setzen sich konkreten Gefahren aus, von ungeeigneten Gesundheitsplänen bis hin zu ruinösen Finanzentscheidungen.

Besonders gravierend ist der Schaden für Lernende, die die Grenzen der Technologie noch nicht einschätzen können und durch solche Beispiele - zum Beispiel als frei zugängliche YouTube-Videos - ein falsches Verständnis von KI entwickeln.

Es erodiert das Vertrauen in echte Experten, die ihre Angebote nicht mit reisserischen Titeln und Bildern präsentieren.

Dieser Vertrauensverlust und sein Potenzial für realen Schaden stellen das zentrale ethische Versäumnis dar: Solche Aussagen untergraben die Bedeutung von Fachwissen und können im schlimmsten Fall gesundheitliche oder finanzielle Schäden nach sich ziehen.

Sie verkennen nicht nur die Komplexität dieser Bereiche, sondern ignorieren auch die Verantwortung, die KI-Berater tragen.

Die Massenpsychologie macht uns anfällig für leere Versprechungen

Um zu verstehen, warum dieser Hype so effektiv ist, muss man die Psychologie hinter Massenbewegungen betrachten. Ein Phänomen, das Gustave Le Bon im 19. Jahrhundert mit scharfer Weitsicht analysierte.

Seine Theorie der Dynamik von Massenbewegungen weist überraschende Parallelen zu heutigen gesellschaftlichen Trends auf.

Obwohl seine Ansichten heute teilweise kritisch gesehen werden, sind sie hilfreich, um die kollektive Psyche zu verstehen und die Entstehung moderner Hypes, etwa im KI-Bereich, besser nachzuvollziehen.

Unseriöse KI-Berater nutzen diese massenpsychologischen Prozesse gezielt aus, indem sie den menschlichen Wunsch nach schnellen, einfachen Lösungen ansprechen. Sie schüren übertriebene Erwartungen, um Aufmerksamkeit zu gewinnen, und machen kritische Fragen zu Bedenkerei.

Durch diese psychologische Anfälligkeit werden falsche Versprechen nicht nur zum Trend, sondern zu einer bewusst kalkulierten Ausbeutung unseres öffentlichen Vertrauens.

Das Risiko besteht darin, dass sich Menschen wegen falscher Erwartungen und irreführender Anwendungsfälle von Technik abwenden, statt wegen mangelnder Transparenz über die Grenzen der Technologie.

Obwohl seine Ansichten heute teils kritisch diskutiert werden, finde ich sie in der Analyse der Kollektivseele hilfreich, um die Dynamik moderner Hypes – etwa im Bereich der KI – besser zu verstehen.

Unseriöse KI-Berater machen sich diese massenpsychologischen Dynamiken gezielt zunutze. Der menschliche Wunsch nach einfachen, schnellen Lösungen wird intensiv getriggert.

Sie schüren überzogene Erwartungen, um Bekanntheit zu erlangen, und reduzieren kritische Nachfragen auf Bedenkenträgerei.

Angesichts dieser psychologischen Anfälligkeit wird die Verbreitung falscher Versprechen nicht nur zum Trend, sondern zu einer bewusst kalkulierten Ausbeutung unseres wichtigen öffentlichen Vertrauens.

Die Gefahr ist, dass Menschen sich durch falsche Erwartungen und irreführende Use Cases von Technik abwenden, nicht durch transparente Kommunikation der Grenzen.

Mehr Verantwortung, weniger Hype

Künstliche Intelligenz ist ein mächtiges Werkzeug, aber sie ist kein Ersatz für menschliches Fachwissen, kritisches Denken und ethische Verantwortung.

KI-Berater und Ausbilder tragen eine besondere Pflicht, die Grenzen der Technologie transparent zu kommunizieren, statt unrealistische Versprechen zu verbreiten.

Letztlich hängt die verantwortungsvolle Integration von KI in unsere Gesellschaft von unserer kollektiven Verpflichtung zur intellektuellen Redlichkeit ab.

Dies hinterlässt uns mit der entscheidenden Frage unseres technologischen Zeitalters: Wie stellen wir sicher, dass Expertise und Ethik nicht in den Hintergrund geraten?

Bildquelle: KI-Ethik: Verantwortung gegen fragwürdige Use Cases, Notebooklm